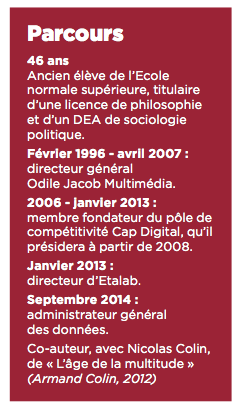

Chargé du pilotage de l’open data en France, Henri Verdier, spécialiste du big data et de la transformation numérique, estime qu’une troisième révolution numérique est en marche, celle de la donnée. Tout juste nommé Chief Data Officer (CDO) du gouvernement (ou administrateur général des données), le directeur de la mission Etalab est placé sous l’autorité du Premier ministre et rattaché au secrétaire général pour la modernisation de l’action publique (SGMAP). La France devient ainsi le premier pays à avoir un CDO au service de son gouvernement.

Propos recueillis par Isabelle Repiton, avec Catherine Moal

Alliancy, le mag. Vous venez d’être nommé administrateur général des données. Quelle est votre mission ?

Henri Verdier. Elle vise au fond la mise en culture et l’exploitation des données. C’est-à-dire s’assurer que l’on dispose des bonnes données, que ceux qui en ont besoin les connaissent et que les décisions soient fondées sur des informations pertinentes. Cela semble basique, mais on ne dispose pas toujours des bonnes données au moment de prendre une décision.

Comment cette fonction est-elle née ?

Cette fonction est née dans des entreprises, puis dans de grandes villes américaines. 90 % des Chief Data Officer dans le monde sont américains. Il en existe quelques-uns en Grande-Bretagne, et ils sont rares en France (par exemple, chez Ogilvy). La France devient ainsi le premier pays à avoir un CDO au service de son gouvernement. C’est une fonction interne à l’Etat, complémentaire de la mission d’ouverture des données publiques qui, elle, consiste à les mettre à la disposition du grand public. Cette mission-là ne concerne pour l’instant ni l’amélioration de la qualité de la donnée, ni sa circulation entre les administrations. Le CDO peut conduire des expérimentations sur l’utilisation des données pour renforcer l’efficacité des politiques publiques.

Quels sont les objectifs de l’open data ? Où en est la France ?

Il y a au moins trois objectifs. D’abord, une démocratie plus aboutie : le citoyen a le droit de savoir… L’open data doit aussi contribuer à l’innovation et à la croissance, et améliorer l’efficacité de l’action publique. Il résulte d’un double mouvement. Celui d’aller vers plus de transparence, qui ne date pas d’hier. La Révolution française a affirmé le droit de la société à demander des comptes aux agents publics, celui du citoyen à constater par lui-même la dépense publique et son efficacité. Les rapports de la Cour des comptes sont publics depuis 1850, et la loi Cada*, qui reconnaît le droit d’accès aux documents administratifs, a presque 40 ans.

L’open data est ce mouvement de transparence, plongé dans Internet : un monde de développement agile, de coproduction avec les citoyens, de crowdsourcing, d’économie de plate-forme. La Californie est encore l’épicentre, mais la France a aussi un grand écosystème numérique, en termes d’inventivité et d’énergie d’entrepreneuriat numérique, dans un peloton qui comprend Israël, la Corée, le Royaume-Uni… L’open data prend donc de l’ampleur dans un pays qui a la double culture de la redevabilité de l’action publique et du numérique. Dans l’e-governement survey de l’ONU, qui englobe l’open data, mais aussi la e-administration, la France est classée 4e dans le monde et première en Europe, et a de ce fait été honorée par l’ONU le 6 octobre dernier. De même, nous avons rejoint, en avril, l’Open Governement Partnership, ce club de 64 pays qui travaillent sur les questions de gouvernement ouvert et de transparence, et nous en avons été élus membres du Comité directeur, le 4 août. C’est une reconnaissance de la maturité de notre pensée dans ce domaine.

Comment mesure-t-on la performance en la matière ? En nombre de jeux de données ouvertes ?

Pas seulement. L’open data n’est pas seulement une quantité de données. C’est aussi un travail sur les formats, pour livrer les données dont les gens puissent se servir, et un travail au service de l’engagement des citoyens. En nombre de jeux, les comparaisons sont difficiles. Par exemple, on entend souvent que la France n’ouvre pas assez ses données de santé. En fait, elle en ouvre à peu près autant que les autres, mais elle en a beaucoup plus. Nous sommes les seuls au monde à avoir une base de données de toutes les ordonnances remboursées…

Ensuite, il y a des différences de sensibilité. Les Etats-Unis, la Grande-Bretagne exigent une transparence plus fine en termes de dépense publique. En Norvège, on peut même demander à lire la correspondance d’un ministre, ses dépenses à l’euro près. Ces pays se sont focalisés sur le contrôle de l’Etat, la transparence de la vie publique. La France, elle, travaille sur les données ressources pour l’innovation. Tous les pays n’ont pas un Institut géographique national (IGN) ou un opérateur de prévisions météorologiques (Météo France) fournissant des données gratuites. On partage aussi beaucoup de données environnementales sur la qualité de l’eau (eaux de baignade…)

L’open data peut être vu soit comme un contre-pouvoir, soit comme une ressource pour les citoyens, la société et l’économie. C’est plutôt la vision française. Sur le portail data.gouv.fr, presque tous les ministères proposent des données : accidents de la route, pollution, transports, cartographie, sociologie, population carcérale, météo, marées… Sur la transparence de la vie publique, beaucoup de choses sont publiées, mais certains vont plus loin que nous. En termes de diversité des thèmes traités, nous sommes sans doute un très grand pays de l’open data.

Et les collectivités locales ?

L’expression open data est devenue à la mode en 2008 avec le décret d’Obama sur la transparence, le jour même de sa prestation de serment. En France, on faisait déjà un open data avant l’heure (Legifrance, Insee) depuis 1995, mais sans appliquer tous les principes de format ouvert et de liberté de réutilisation. Les premières collectivités territoriales ont lancé des portails d’open data dès 2009, et l’Etat en 2011. De grandes villes comme Paris, Lyon, Brest, Rennes, Montpellier ont développé leurs propres stratégies, par exemple autour de projets de villes intelligentes : elles  ont partagé des données sur les transports, les bornes Velib’, des informations géographiques. La Saône-et-Loire a poussé très loin la logique de transparence. Pour bâtir son plan de désendettement et de redressement, le département a rassemblé les données permettant d’identifier les meilleures économies. La collecte, la centralisation, puis l’ouverture des données, ont permis de prendre des décisions d’économie, et de les expliquer au public. Aujourd’hui, on compte une soixantaine d’acteurs territoriaux très engagés. Et il y a une pression pour que les 36 000 communes ouvrent leurs données. Toutes ne sont pas prêtes. La ligne est plutôt de dire : « Commencez par ouvrir ce que vous avez, ce ne sera pas parfait, faites appel à l’intelligence de la multitude et laissez les gens trouver des interpolations, nettoyer les données. »

ont partagé des données sur les transports, les bornes Velib’, des informations géographiques. La Saône-et-Loire a poussé très loin la logique de transparence. Pour bâtir son plan de désendettement et de redressement, le département a rassemblé les données permettant d’identifier les meilleures économies. La collecte, la centralisation, puis l’ouverture des données, ont permis de prendre des décisions d’économie, et de les expliquer au public. Aujourd’hui, on compte une soixantaine d’acteurs territoriaux très engagés. Et il y a une pression pour que les 36 000 communes ouvrent leurs données. Toutes ne sont pas prêtes. La ligne est plutôt de dire : « Commencez par ouvrir ce que vous avez, ce ne sera pas parfait, faites appel à l’intelligence de la multitude et laissez les gens trouver des interpolations, nettoyer les données. »

Qui dépose aujourd’hui des données sur data.gouv.fr ?

Depuis 2013, tout le monde peut y déposer un jeu de données, à condition de s’identifier. 336 organisations différentes le font, dont deux tiers ne sont pas des organismes publics. Les données doivent être sourcées, factuelles. La fiabilité est contrôlée a posteriori par Etalab et par la communauté, à la façon de Wikipédia. L’information d’autorité fournie par des services de l’Etat est distinguée, les autres n’engagent pas l’Etat. C’est un changement de philosophie de l’open data : nous sommes passés d’une vitrine pour satisfaire à la demande de transparence à l’idée que les données sont un bien commun essentiel, et qui doit être coproduit et co-utilisé. L’Etat gagne à s’allier à une communauté de gens qui savent utiliser la donnée. La nouvelle version du site qui vient d’être mise en ligne met en avant les meilleures réutilisations des données. On compte déjà plus de 1 300 réutilisations – un logiciel, une cartographie, une datavisualisation, un article… –, venant de toute la société civile et de personnes qui utilisent les données publiques pour produire du sens.

Les données doivent-elles être gratuites ?

On peut séparer deux raisonnements. De manière générale, les données ne prennent de la valeur que si les gens s’en servent. Un prix prohibitif freine leur utilisation. Des entreprises commencent à apprendre à travailler avec des stratégies d’open data permettant des alliances avec leur client-contributeur. Laisser gratuite la donnée brute peut également permettre de se focaliser sur des services à valeur ajoutée. Bloomberg, par exemple, utilise des données boursières gratuites et se concentre sur la vente de terminaux qui les traitent, et apportent une valeur ajoutée maximale. L’Etat peut parfois appliquer ces raisonnements, mais il en applique aussi un autre. Il doit reconnaître le droit du citoyen à accéder gratuitement et à réutiliser librement les données produites par son administration à l’occasion de ses missions de service public.

Est-il légitime que les données publiques gratuites soient réutilisées par des services commerciaux et des acteurs privés pour leurs profits?

Les données font partie des externalités économiques que l’Etat fabrique depuis toujours, comme les routes, l’éducation… Des externalités particulières : elles s’apprécient quand les gens s’en servent. Il en va souvent de la transparence. Combien d’accidents de la route ? Le niveau en maths progresse-t-il ? Quelle est la population carcérale ? L’Etat a le devoir de le savoir et de le partager. Ensuite, si on veut des informations particulières, c’est différent. C’est un service rendu que l’on est en droit de facturer. Il est important de considérer ces externalités, car des pans entiers de l’économie seront fondés sur la donnée. On assiste à une sorte de mathématisation du monde et du savoir collectif. De plus en plus, des capteurs produisent des données, et tout est connecté. On est en train de « data-ifier » le monde tout en mettant le citoyen au centre du jeu. Quand on en arrivera aux données qui sont les infrastructures critiques de la modernité, à des flux massifs de données temps réel décrivant des morceaux entiers du réel – la consommation des compteurs électriques, la circulation des trains… –, on pourra réfléchir aux différentes stratégies de gratuité.

Il y a donc plusieurs types d’ouverture des données…

On peut ouvrir en laissant les gens s’approprier les données. On peut ouvrir en laissant les gens interroger une base de données que l’on conserve. Si, demain, les données des compteurs électriques intelligents constituent une grosse infrastructure de données sur l’énergie, qui commande une filière industrielle entière, on peut l’ouvrir à la consultation, tout en la gardant chez EDF. C’est ce que fait Facebook : vous pouvez faire des requêtes, utiliser son Open Graph Protocol, mais pas l’aspirer. Facebook reste au centre du jeu. C’est une stratégie de plate-forme. Le réseau GPS est un autre exemple. Beaucoup d’entreprises développent des services utilisant les coordonnées GPS, mais les Américains gardent le contrôle de l’infrastructure satellite. C’est la différence entre open data et open API (Application Programming Interface).

On peut aussi travailler les conditions de licence (dites share alike) qui autorisent des utilisations aux acteurs, qui partagent gratuitement le fruit de leur traitement des données. Pour les données qui n’entrent pas dans le cadre du droit des documents administratifs, il existe donc toute une gamme de stratégies d’ouverture…

Sous l’angle de la souveraineté numérique, on peut ouvrir en restant la plate-forme centrale.

Face aux réticences à ouvrir des données de peur que Google vienne s’en servir, je réponds : si Google est capable de créer de la valeur à partir de vos données, et que vous ne les ouvrez pas, alors il va les produire lui-même. La seule alternative, c’est de prendre des positions avant. Par ailleurs, si on libère des ressources pour l’innovation, il est préférable d’avoir des entreprises innovantes. L’open data donnera la totalité de son impact économique, si on a une politique industrielle qui va avec. C’est la direction qu’a ouvert le plan industriel sur le big data.

Comment les données publiques créent-elles de la valeur ?

Dès à présent, des centaines de start-up utilisent les données publiques que nous partageons. Cela représente des milliers d’emplois. Il y a aussi une valeur sociale, souvent sous-estimée, avec la création de services non marchands. Des centaines d’associations d’aide au retour à l’emploi, au handicap, de protection de la faune, d’aménagement du territoire… produisent des services gratuits. Ils n’auraient pas pu les lancer s’ils avaient dû acheter les données qu’ils utilisent.

Enfin, de grandes groupes prennent de meilleures décisions. Par exemple, une enseigne de grande distribution a besoin de données publiques pour implanter ses magasins : densité de la population, pouvoir d’achat, transport… Depuis peu, on a publié la carte des accidents corporels horodatés et géolocalisés. Des assureurs s’en sont servis pour compléter leurs données. Il existe de longue date de l’industrie autour des données météorologiques et géographiques. Si on leur retirait ces données, certains secteurs économiques vacilleraient sur leurs bases.

A-t-on déjà des exemples d’amélioration d’efficacité de l’action publique grâce à l’open data ?

Le premier effet au quotidien est un effet de modernité. Quand on dit à l’administration : « Arrêtez d’avoir peur de montrer vos données à un autre service. Et ce n’est pas grave, s’il y a quelques erreurs, cela permettra même de les corriger », on contribue à décloisonner l’administration et à encourager la coopération. Ce n’est pas rien !

Second effet : l’open innovation (lire aussi page 52). Les gens s’organisent pour partager les données et aller chercher des intelligences à l’extérieur. On a fait des dizaines de hackatons, de datacamps, de journées de travail, qui ont fait naître des projets passionnants dans l’administration française : partenariats avec des start-up, des étudiants, recrutements de profils originaux.

Vous auriez un exemple à citer ?

Il n’existe pas en France, en open data, une base de données vraiment complète de toutes les adresses géolocalisées. Nous avons décidé de soutenir Open Street Map (le Wikipédia de la cartographie), animé par une communauté très active de quelque 15 000 contributeurs en France. Open Street Map France a lancé le projet Bano (base nationale d’adresses ouvertes) et Etalab les soutient. A la différence de Google Street View, c’est une logique open source : vous pouvez contribuer, enrichir, utiliser, sans risque de voir un jour Google couper l’accès aux données. Et vous pouvez télécharger le serveur Open Street Map pour développer des applications, sans que Google ou la NSA ne puissent les surveiller…. Plusieurs SAMU ou polices municipales commencent à utiliser cette nouvelle infrastructure.

Enfin, la mise à disposition de ces données bénéficie à l’Etat lui-même, qui pourra s’en servir pour ouvrir le chantier des stratégies fondées pour la donnée, et rechercher de nouvelles méthodes de conception, d’évaluation voire de pilotage des politiques publiques. Ce sera l’une des missions de l’administrateur général des données.

Faut-il légiférer sur l’open data ? Instaurer, par exemple, un droit de réquisition pour le CDO ?

C’est une décision qui appartient au gouvernement, pas à l’administration. Je peux seulement remarquer que la loi Cada date un peu et mérite des améliorations. Par exemple, sur la façon dont on doit transmettre l’information au citoyen (le lien entre transmission et publication), ou sur la manière d’accélérer la mise en œuvre d’un avis de la Cada : aujourd’hui, la Cada a un avis consultatif. Si elle donne raison sur l’accès à un document administratif, il faut ensuite aller devant le tribunal administratif. C’est long. On pourrait imaginer un référé.

Au-delà, tout le monde convient qu’il sera utile au sein de l’Etat, d’avoir quelqu’un qui ait une vue d’ensemble de toutes les données qui existent, et puisse ainsi évaluer ce qui doit être ouvert. Cependant, les secrets qui protègent certaines données – secret défense, secret fiscal, secret des affaires, secret médical – ont été instaurés au fil du temps pour de bonnes raisons. Donc, il faut construire un « droit d’en connaître » plutôt qu’un droit de réquisition. L’administrateur de données va pouvoir mener des expérimentations, dans un cadre qui reste conforme, par exemple, aux exigences de la loi Informatique et libertés.

Quels seront les prochains chantiers ?

Il y a trois sujets qui se recoupent partiellement : l’open data, l’Open Government et le big data. L’open data est devenu facile, avec le nouveau portail data.gouv.fr. Une communauté est en train de naître et de se développer. On l’accompagne, mais le mouvement est parti. Le prochain chantier sera l’ouverture de données structurantes, ou à forte valeur ajoutée pour les citoyens.

Sur l’Open Government, un chantier s’ouvre dans le dialogue avec la société civile, pour connaître ses aspirations, les progrès qu’elle attend. La consultation sur la future loi numérique, lancée le 18 septembre, en donnera l’occasion. C’est aussi un sujet de relations internationales. La France est au comité directeur de l’Open Government Partnership, où siègent pour moitié des gouvernements, pour moitié des représentants de la société civile, des ONG. La France a ses valeurs à promouvoir : on pourrait, par exemple, demander la transparence sur les paradis fiscaux, l’évasion fiscale, la contribution de chaque pays au réchauffement…

donnera l’occasion. C’est aussi un sujet de relations internationales. La France est au comité directeur de l’Open Government Partnership, où siègent pour moitié des gouvernements, pour moitié des représentants de la société civile, des ONG. La France a ses valeurs à promouvoir : on pourrait, par exemple, demander la transparence sur les paradis fiscaux, l’évasion fiscale, la contribution de chaque pays au réchauffement…

Le big data enfin, doit permettre à terme de définir des stratégies d’action, de pilotage serré en temps réel par la donnée. Quand votre véhicule vous alerte en temps réel que vous êtes en excès de vitesse, vous changez votre comportement. Cela peut s’appliquer à d’autres domaines. On pourra améliorer l’efficacité et les comportements quand on sera capable de piloter l’action publique à partir de la donnée en internalisant les méthodes des datasciences. Cela se fait déjà à Bercy, dans la recherche de la fraude fiscale. Les services statistiques de certains ministères utilisent aussi le big data, par exemple sur la prévention routière. Mais ce n’est pas encore un réflexe, une méthode systématique, généralisée.

* La loi Cada

La loi n°78-753 du 17 juillet 1978 reconnaît à toute personne le droit d’obtenir communication des documents détenus dans le cadre de sa mission de service public par une administration, quels que soient leur forme ou leur support. Elle crée une Commission d’accès aux documents administratifs (la Cada) pour assurer la bonne application du droit d’accès.

International

International Nominations

Nominations Politique publique

Politique publique