Au Sénat, le colloque “Aligner l’IA” a réuni chercheurs, entrepreneurs et responsables publics pour redéfinir la stratégie européenne de l’intelligence artificielle. Entre souveraineté, sécurité et éthique, l’Europe cherche à transformer la contrainte réglementaire en moteur de puissance technologique.

Le Vieux Continent n’a plus le luxe d’observer la révolution technologique depuis le trottoir d’en face. « L’intelligence artificielle bouleverse nos sociétés à une vitesse inédite. L’Europe doit cesser de subir et redevenir actrice », a ouvert Vanina Paoli-Gagin, sénatrice de l’Aube, devant les 150 participants réunis le 27 octobre au Palais du Luxembourg. Chercheurs, start-up, dirigeants et décideurs publics y ont débattu d’un enjeu devenu stratégique : aligner l’intelligence artificielle sur les valeurs humaines et démocratiques, sans perdre la course à l’innovation. L’événement, intitulé “Aligner l’IA : faire d’un impératif une opportunité stratégique pour l’Europe”, a marqué un tournant. Loin du seul registre éthique, il a mis en scène la volonté d’articuler innovation, souveraineté et puissance industrielle.

De la régulation à la puissance

Longtemps, l’Europe a fait de la prudence sa marque de fabrique, parfois au détriment de son influence. « L’intelligence artificielle n’est pas une technologie parmi d’autres, c’est un instrument de puissance », a rappelé Flavien Chervet, analyste de l’IA et auteur d’Hyperarme (Éditions NIV, 2025). « En définissant les règles qui la guident, l’Europe définit la place qu’elle veut occuper dans le monde. » Ce message trouve aujourd’hui un écho politique. Depuis sa nomination en septembre 2025 comme ministre déléguée chargée de l’Intelligence artificielle et du Numérique, Anne Le Hénanff défend une approche proactive : « Nous devons faire de l’éthique un levier de compétitivité, pas une contrainte. L’Europe peut inventer un modèle d’IA qui conjugue innovation, sécurité et souveraineté. » Le colloque a donc acté un changement de ton. Plutôt que de suivre les géants américains ou chinois, les intervenants ont plaidé pour une stratégie de long terme : concevoir une IA européenne capable d’incarner un modèle alternatif, fondé sur la transparence et la responsabilité.

Aligner science et conscience

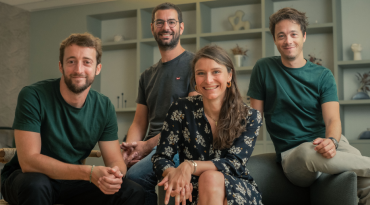

La question de l’alignement est à la fois technique, philosophique et politique. « L’intelligence artificielle n’est pas qu’une affaire de technologie, c’est une question de civilisation », a souligné Jean-Michel Adélaïde, président de la Fondation de l’Université de Technologie de Troyes (UTT), coorganisateur de l’événement. « Il faut apprendre à aligner la science sur la conscience. » Cette exigence prend une résonance particulière alors que les IA génératives et agentiques bouleversent déjà l’économie et les pratiques. Dans un dialogue entre Chloé Touzet (SaferAI) et Charbel-Raphaël Segerie (CESIA), la question de la confiance est revenue comme un fil rouge : comment instaurer une coopération européenne durable entre recherche, industrie et régulation pour garantir une IA responsable ? Les intervenants ont insisté sur l’urgence d’une approche collective. L’IA de confiance ne se décrète pas, elle se construit à travers des cadres communs, des tests de robustesse, des standards partagés et des alliances industrielles capables de rivaliser avec les géants non européens.

De la stratégie à l’action

Au-delà des déclarations d’intention, le colloque a aussi produit des décisions concrètes. Deux annonces majeures illustrent cette volonté de passer de la parole à l’action. La première est le dépôt d’une Proposition de Résolution Européenne (PPRE) sur l’alignement de l’IA, portée par Vanina Paoli-Gagin. Son objectif : inscrire durablement la question dans l’agenda politique européen et encourager une régulation commune des modèles d’IA à haut risque. Cette résolution vise également à mieux coordonner les politiques nationales pour éviter la fragmentation du marché européen. La seconde initiative est la création d’un groupe de travail soutenu par le Secrétariat général pour l’investissement (SGPI). Cette instance, réunissant experts publics, industriels et académiques, formulera des recommandations opérationnelles pour structurer une filière européenne de l’IA de confiance, de la recherche fondamentale à la production d’outils certifiés. « Nous devons bâtir une véritable filière industrielle de l’IA, capable de produire ses propres standards et ses propres champions », a martelé Anne Le Hénanff, évoquant la nécessité d’une coordination entre les programmes nationaux et le futur AI Act européen.

L’IA, pilier de souveraineté et de défense

La journée s’est conclue sur un ton plus stratégique. « L’IA est devenue un pilier de la puissance. Si nous n’investissons pas dans sa maîtrise, nous perdrons notre autonomie », a averti Bertrand Rondepierre, directeur de l’Agence ministérielle pour l’intelligence artificielle de défense (AMIAD). L’enjeu dépasse la simple question économique : il touche à la résilience technologique et à la sécurité collective. La défense, par sa capacité d’investissement et son besoin d’IA explicable, pourrait devenir un laboratoire d’innovation utile au civil. Au fil des échanges, une conviction s’est imposée : l’Europe n’a pas à choisir entre innovation et régulation. Sa force pourrait justement résider dans sa capacité à faire de la gouvernance une ressource stratégique. « Aligner l’IA, c’est apprendre à faire de la puissance un levier de sens », a résumé Flavien Chervet. En filigrane, une ambition nouvelle se dessine : bâtir un modèle d’IA européen fondé sur la responsabilité, capable non seulement de protéger ses citoyens, mais aussi de rivaliser sur la scène mondiale. L’alignement, loin d’être une contrainte, devient ainsi l’acte fondateur d’une souveraineté numérique assumée.

Tech In Sport

Tech In Sport Green Tech Leaders

Green Tech Leaders Alliancy Elevate

Alliancy Elevate International

International Nominations

Nominations Politique publique

Politique publique