Quels sont les plans de Nvidia pour « l’IA physique » ? Notre chroniqueur Stéphane Gervais a pu avoir un aperçu de la stratégie de l’entreprise sur les véhicules autonomes, à travers son projet « Nividia Halos » : il revient sur ses principales caractéristiques.

Lors de la conférence NVIDIA GTC 2025 à Washington DC, Jensen Huang, CEO de NVIDIA, Marco Pavone, Senior Director of Autonomous Vehicle Research, et Riccardo Mariani, Vice President of Industry Safety, ont exposé une vision qui dépasse largement la seule puissance de calcul. Leur message commun est sans ambiguïté : la prochaine frontière de l’intelligence artificielle ne sera pas définie uniquement par la performance ou l’échelle, mais par la confiance. Avec le lancement de Nvidia Halos, un cadre complet de sécurité et de certification pour l’IA physique, et la création du Halos AI Systems Inspection Lab, Nvidia pose les fondations d’un futur où les systèmes intelligents sont non seulement autonomes, mais aussi certifiables, explicables et dignes de confiance.

De la puissance à la confiance : la nouvelle ère de l’IA

L’intelligence artificielle a franchi un cap décisif. Elle n’est plus confinée aux data centers ou aux modèles abstraits. Elle agit désormais dans les véhicules, les robots et les systèmes industriels, influençant directement des décisions dans le monde physique. Comme l’a affirmé Jensen Huang lors de sa keynote à GTC 2025 : « L’IA n’est pas un outil. L’IA est le travail. Elle opère dans le monde réel – et doit donc être vérifiable, explicable et sécurisée. » Cette conviction structure l’évolution stratégique de Nvidia. Les plateformes de calcul ne sont plus seulement optimisées pour la performance, mais aussi pour la responsabilité, avec des mécanismes d’assurance intégrés nativement au matériel, aux logiciels et à l’architecture système.

Pourquoi Nvidia a créé le Halos AI Systems Inspection Lab.

Lors de notre échange, Riccardo Mariani a souligné que Halos est né d’un constat simple mais critique : la complexité croissante des systèmes d’IA dépasse aujourd’hui les cadres traditionnels de certification. « La complexité des systèmes basés sur l’IA est telle que nous devons aider notre écosystème à accélérer leur mise en conformité et leur accès à la certification », explique-t-il. « Nous devons aussi les aider à utiliser efficacement les composants Halos. C’est précisément pour cela que nous avons créé le Halos AI Systems Inspection Lab. » La mission du laboratoire est claire : permettre à la sécurité de l’IA physique, à la cybersécurité et à la conformité réglementaire d’évoluer de concert, en transformant l’assurance non plus en contrainte, mais en levier d’innovation. Riccardo Mariani décrit le laboratoire comme « un pont entre l’innovation et la régulation », un espace où les technologies d’IA les plus avancées sont soumises à des inspections structurées et impartiales.

Ce qui rend le Halos AI Systems Inspection Lab unique

Contrairement aux structures d’audit classiques, Halos a été conçu comme un modèle d’assurance global et intégré. « Nous connaissons nos composants Halos mieux que quiconque, ce qui nous permet d’accompagner nos clients de manière extrêmement efficace », précise Riccardo Mariani. « Lors de notre accréditation par l’ANAB, il a été souligné que nous étions les premiers à combiner sécurité fonctionnelle, cybersécurité, sécurité de l’IA et réglementation dans un cadre unifié. Notre lien étroit avec les organismes de certification constitue un autre élément distinctif. » Le laboratoire s’appuie sur une méthodologie d’inspection multi-domaines. Des experts accrédités – sécurité fonctionnelle, cybersécurité, éthique de l’IA – conduisent des évaluations indépendantes, ensuite consolidées dans un rapport d’inspection global.

Des modèles sûrs aux systèmes sûrs

Pour Riccardo Mariani, l’enjeu ne réside pas uniquement dans la certification des algorithmes, mais dans la capacité à répartir clairement les responsabilités au sein d’un écosystème d’IA de plus en plus distribué. « La sécurité aujourd’hui concerne la collecte et la génération des données, l’entraînement et le déploiement des modèles, ainsi que la répartition des responsabilités dans l’écosystème », explique-t-il. « Il ne s’agit pas seulement de robustesse, mais aussi d’explicabilité, de biais et d’éthique. » Cette approche systémique est essentielle, car l’IA moderne implique une pluralité d’acteurs : concepteurs de modèles, intégrateurs de systèmes, opérateurs d’applications. Halos introduit des cadres de redevabilité permettant de tracer les décisions et les risques tout au long du cycle de vie de l’IA.

La sécurité comme principe d’ingénierie de bout en bout

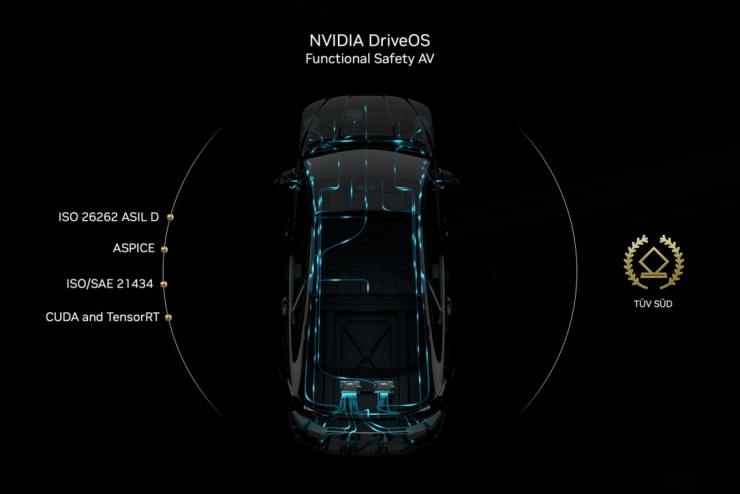

À GTC, Jensen Huang a réaffirmé l’engagement de Nvidia à faire de la sécurité un principe fondamental de conception : « Le système Halos de Nvidia, ainsi que nos équipes et capacités en sécurité des véhicules autonomes, sont mondialement reconnus. Cet ordinateur fut le premier entièrement défini par logiciel, le premier stack 100 % software-defined et piloté par l’IA pour les véhicules autonomes. » Halos concrétise cette vision en proposant une architecture de sécurité inspectable. Chaque composant clé – comme NVIDIA DriveOS – est accompagné de manuels de sécurité et de cybersécurité définissant précisément les exigences pour les intégrateurs. « Ce sont ces exigences que nous inspectons », souligne Riccardo Mariani. « Nous vérifions que nos partenaires les appliquent correctement et qu’ils atteignent le niveau attendu d’un système certifiable. »

Construire un écosystème de confiance

La force de Halos réside dans sa capacité à connecter l’ensemble de la chaîne de valeur de l’IA. « Pour qu’un tel cadre fonctionne, chaque maillon doit être interconnecté », explique Riccardo Mariani. « Des fabricants de matériel aux fournisseurs d’outils et de services, jusqu’aux organismes de certification et aux régulateurs. » Pour favoriser cette dynamique, Nvidia organise les Halos AV Safety Days, des rencontres réunissant développeurs, régulateurs et partenaires afin de partager les meilleures pratiques et d’anticiper les nouveaux besoins en matière d’assurance. Le Halos AI Systems Inspection Lab devient ainsi un accélérateur communautaire de confiance numérique, au-delà de sa fonction d’inspection.

Standards internationaux et évolution continue

Halos s’inscrit en cohérence avec les standards internationaux, tout en contribuant à leur évolution. « Nous sommes alignés sur les normes et formés par elles », indique Riccardo Mariani, « mais nous contribuons également à les influencer. Nous apprenons des réglementations européennes, américaines et chinoises pour construire une méthodologie d’inspection réellement efficace, sans surcharges inutiles. » À mesure que les modèles évoluent – des réseaux neuronaux profonds aux modèles fondamentaux et de raisonnement – les méthodes du laboratoire s’adaptent aux nouveaux risques. « Au départ, le monde de la sécurité traditionnelle était réticent », se souvient-il. « Aujourd’hui, il comprend que l’IA et la sécurité ne sont pas opposées : ce sont de très bons alliés. »

Jalons clés et feuille de route

• Janvier 2025 : Lancement du NVIDIA AI Systems Inspection Lab et obtention de l’accréditation ANSI

• Mars 2025 : Lancement officiel de NVIDIA Halos à GTC San Jose avec l’adhésion de nombreux partenaires du véhicule autonome

• Juin 2025 : Extension de Halos à la sécurité de l’IA physique pour la robotique

• Octobre 2025 : Publication du Halos Outside-In Functional Safety Agent pour la robotique

• 2026 : Évolution prévue vers un laboratoire de test, avec de nouvelles capacités de validation

Riccardo Mariani résume cette trajectoire comme « un cycle de vie de l’assurance qui évolue au rythme de la technologie ».

Une vision globale

En définitive, Halos incarne la réponse de Nvidia à une problématique mondiale : comment rendre les systèmes d’IA physique fiables par conception. « Nous avons conçu Halos pour intégrer la diversité, la transparence et l’explicabilité à chaque niveau du design », affirme Jensen Huang. En combinant rigueur d’ingénierie et responsabilité éthique, Halos transforme la sécurité en actif stratégique, moteur d’adoption plutôt qu’obligation réglementaire. Il illustre une conviction partagée par les dirigeants de Nvidia : l’avenir des systèmes autonomes dépendra de notre capacité à rendre l’intelligence certifiable.

Illustration : Nvidia – Sécurité des véhicules autonomes

Tech In Sport

Tech In Sport Green Tech Leaders

Green Tech Leaders Alliancy Elevate

Alliancy Elevate International

International Nominations

Nominations Politique publique

Politique publique